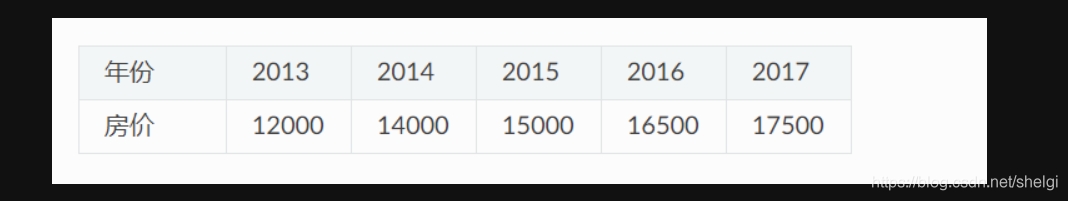

import numpy as np

year=np.array([2013,2014,2015,2016,2017],dtype=np.float32)

price=np.array([12000,14000,15000,16500,17500],dtype=np.float32)

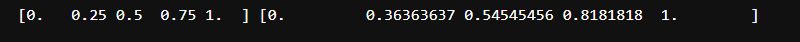

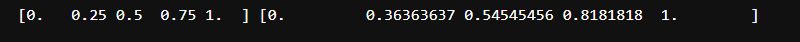

x=(year-year.min())/(year.max()-year.min())

Y=(price-price.min())/(price.max()-price.min())

print(x,Y)

������,����ʹ���ݶ��½�������������ģ������������ a �� b ��ֵ 3��

�ع˻���ѧϰ�Ļ���֪ʶ,���ڶ�Ԫ���� f(x) ��ֲ���Сֵ,�ݶ��½� �Ĺ�������:

��ʼ���Ա���Ϊ x_0 , k=0

�����������в���ֱ��������������:

���� f(x) �����Ա������ݶ�

?

f

(

x

k

)

\nabla f(x_k)

?f(xk?)

�����Ա���:

x

k

+

1

=

x

k

?

��

?

f

(

x

k

)

x_{k+1} = x_{k} - \gamma \nabla f(x_k)

xk+1?=xk?