1 import json

2 import requests

3 from bs4 import BeautifulSoup

4 import filecmp

5 import time

6 import threading

7

8

9 class listenThread(threading.Thread):

10 def __init__(self, url, originFile, newFile, content):

11 threading.Thread.__init__(self)

12 self.url = url

13 self.originFile = originFile

14 self.newFile = newFile

15 self.content = content

16

17 def listen(self):

18 headers = {

19 "User-Agent": "Mozilla/5.0 (Linux; Android 9; SM-A102U) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/79.0.3945.93 Mobile Safari/537.36",

20 'Content-Type': 'application/json'

21 }

22 html = requests.get(url=self.url, headers=headers)

23 soup = BeautifulSoup(html.text, 'lxml')

24 html.close()

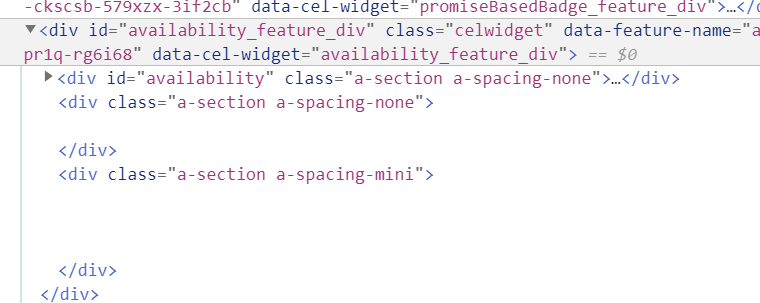

25 target = str(soup.find('div', id='availability_feature_div'))

26 filetxt = open(self.originFile, 'w', encoding='utf-8')

27 filetxt.write(target)

28 filetxt.close()

29 while True:

30 target = str(soup.find('div', id='availability_feature_div'))

31 filetxt = open(self.newFile, 'w', encoding='utf-8')

32 filetxt.write(target)

33 filetxt.close()

34 if filecmp.cmp(self.originFile, self.newFile) == False:

35 post_push('这里输你自己的token', 'xbox update', self.content)

36 fileAvail = open(self.originFile, 'w')

37 fileAvail.write(target)

38 fileAvail.close()

39 time.sleep(30)

40 def run(self):

41 self.listen()

42

43

44 def post_push(token, title, content):

45 url = 'http://pushplus.hxtrip.com/send'

46 data = {

47 "token": token,

48 "title": title,

49 "content": content

50 }

51 body = json.dumps(data).encode(encoding='utf-8')

52 headers = {'Content-Type': 'application/json'}

53 requests.post(url, data=body, headers=headers)

54

55

56 if __name__ == '__main__':

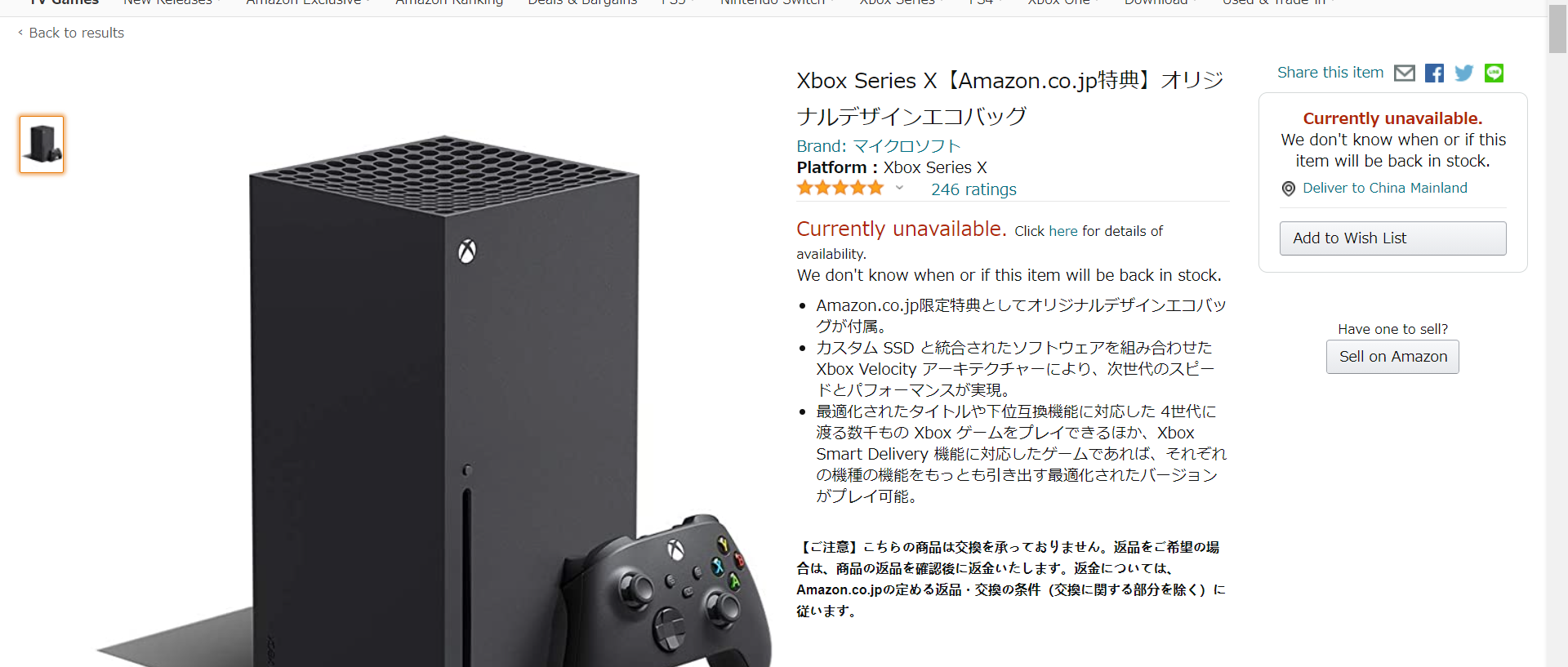

57 detect_url = 'https://www.amazon.co.jp/-/en/dp/B08GGKZ34Z/ref=sr_1_2?dchild=1&keywords=xbox&qid=1611674118&sr=8-2'

58 #url_special = 'https://www.amazon.co.jp/-/en/dp/B08GG17K5G/ref=sr_1_6?dchild=1&keywords=xbox%E3%82%B7%E3%83%AA%E3%83%BC%E3%82%BAx&qid=1611722050&sr=8-6'

59 url_germany = 'https://www.amazon.de/Microsoft-RRT-00009-Xbox-Series-1TB/dp/B08H93ZRLL/ref=sr_1_2?__mk_de_DE=%C3%85M%C3%85%C5%BD%C3%95%C3%91&dchild=1&keywords=xbox&qid=1611742161&sr=8-2'

60 xbox = listenThread(url=detect_url,originFile='avail.txt',newFile='avail_now.txt',content='日亚')

61 #xbox_sp = listenThread(url=detect_url,originFile='avail_sp.txt',newFile='avail_now_sp.txt')

62 xbox_germany = listenThread(url=url_germany,originFile='avail_sp.txt',newFile='avail_now_sp.txt',content='德亚')

63 xbox.start()

64 #xbox_sp.start()

65 xbox_germany.start()

里面OriginFile和NewFile的文件名可以随意命名,OriginFile指的是之前爬虫的html,NewFile是新的爬虫html,如果内容不一样,就会收到微信消息推送啦

这个图只是测试用的,这个时刻日亚也没有真的补货哈哈哈

这个图只是测试用的,这个时刻日亚也没有真的补货哈哈哈