准备工作:

首先,我们需要 import 几个工具包,一个是 python 标准库中的 wave 模块,用于音频处理操作,另外两个是 numpy 和 matplot,提供数据处理函数。

一:读取本地音频数据

处理音频第一步是需要从让计算机“听到”声音,这里我们使用 python 标准库中自带的 wave模块进行音频参数的获取。

(1) 导入 wave 模块

(2) 使用 wave 中的函数 open 打开音频文件,wave.open(file,mode)函数带有两个参数, 第一个 file 是所需要打开的文件名及路径,使用字符串表示;第二个 mode 是打开的模式,也是用字符串表示 ('rb'或'wb')

(3) 打开音频后使用 getparams() 获取音频基本的相关参数(nchannels:声道数,

sampwidth:量化位数或量化深度,framerate:采样频率,nframes:采样点数)

# 导入 wave 模块

import wave

# 用于绘制波形图

import matplotlib.pyplot as plt

# 用于计算波形数据

import numpy as np

# 用于系统处理,如读取本地音频文件

import os

# 打开WAV文档

f = wave.open(r"2.wav",'rb' )

# 读取格式信息

params = f.getparams ()

nchannels,sampwidth, framerate, nframes = params [:4]

print(framerate)

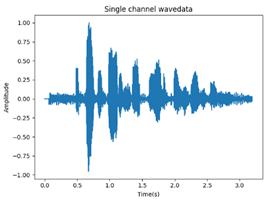

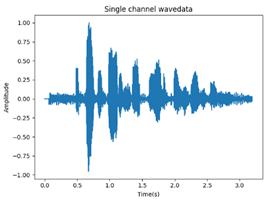

二:读取单通道音频,并绘制波形图(常见音频为左右2个声道)

(1) 通过第一步,可以继续读取音频数据本身,保存为字符串格式

readframes:

读取声音数据,传递一个参数指定需要读取的长度(以取样点为单位),readframes返回的是二进制数据(一大堆bytes),在Python中用字符串表示二进制数据。

strData = f.readframes(nframes)

(2) 如果需要绘制波形图,则需要将字符串格式的音频数据转化为 int 类型

frombuffer:

根据声道数和量化单位,将读取的二进制数据转换为一个可以计算的数组。

通过frombuffer函数将二进制转换为整型数组,通过其参数dtype指定转换后的数据格式。

waveData=np.frombuffer(strData,dtype=np.int16)

此处需要使用到 numpy 进行数据格式的转化

(3) 将幅值归一化

把数据变成(0,1)之间的小数。主要是为了数据处理方便提出来的,把数据映射到0~1范围之内处理,更加便捷快速。

waveData=waveData*1.0/(max(abs(waveData)))

这一步去掉也可画出波形图,可以尝试不用此步,找出波形图的不同

(4) 绘制图像

通过取样点数和取样频率计算出取样的时间:

time = np.arange(0,nframes)*(1.0/framerate)

import wave

# 导入 wave 模块

import matplotlib.pyplot as plt

# 用于绘制波形图

import numpy as np

# 用于计算波形数据

import os

# 用于系统处理,如读取本地音频文件

f = wave.open(r"di.wav",'rb' )

params = f.getparams ()

nchannels,sampwidth, framerate, nframes = params [:4]

print(framerate)

# 读取波形数据

strData = f.readframes(nframes)

# 将字符串转换为16位整数

waveData = np.frombuffer(strData,dtype=np.int16)

# 幅值归一化

waveData = waveData*1.0/(max(abs(waveData)))

#计算音频的时间

time = np.arange(0,nframes)*(1.0 / framerate)

plt.plot(time,waveData)

plt.xlabel("Time(s)")

plt.ylabel("Amplitude")

plt.title("Single channel wavedata")

plt.show()

效果图

js