从单幅图像学习生成模型,可应用于多种图像处理操作

一种可以从单幅自然图像学习的非条件生成模型–SinGAN,能够捕捉图像的内部块分布信息,生成具有相同视觉内容的高质量、多变的样本。

什么是GAN

生成式对抗网络(GAN, Generative Adversarial Networks )是一种深度学习模型,是近年来复杂分布上无监督学习最具前景的方法之一。模型通过框架中(至少)两个模块:生成模型(Generative Model)和判别模型(Discriminative Model)的互相博弈学习产生相当好的输出。原始 GAN 理论中,并不要求 G 和 D 都是神经网络,只需要是能拟合相应生成和判别的函数即可。但实用中一般均使用深度神经网络作为 G 和 D 。一个优秀的GAN应用需要有良好的训练方法,否则可能由于神经网络模型的自由性而导致输出不理想。

- 判别模型:给定一张图,判断这张图里的动物是猫还是狗

- 生成模型:给一系列猫的图片,生成一张新的猫咪(不在数据集里)

1、单幅图像深度模型

最近的一些工作提出在单个样本上训练一个“过拟合”的深度模型,它们都是为特定任务设计的,如超分辨率重建、纹理扩展等。Shocher等提出的InGAN是第一个基于内部GAN的单幅自然图像训练模型,其生成的样本取决于输入图像(即将图像映射到图像),并不能绘制随机样本。而本文框架是纯粹生成式的(即将噪声映射到图像样本),因此适合许多不同的图像处理任务。目前非条件单幅图像GAN模型仅对有纹理的图像进行研究,当在没有纹理的图像上训练这些模型时,不会生成有意义的样本,而本文方法不限于纹理,可以处理一般的自然图像。

2、用于图像处理的生成模型

在许多不同的图像处理任务中,基于GAN的方法已经证明了对抗学习的巨大优势,包括交互式图像编辑,草图合成图像和其他图像到图像翻译任务。但是,所有这些方法都是在特定类别的数据集上进行训练的,通常需要另外的输入信号调整生成。本文不关注如何获取同一类图像间的共同特征,而是考虑使用不同的训练数据源–单幅自然图像的多个尺度上所有重叠的图像块。作者表明,可以从这样的数据中学习强大的生成模型,并将其用于许多图像处理任务中。

该文章采用的方法

本文目标是学习一个非条件的生成模型,该模型可以捕捉单个训练图像x的内部统计信息。此任务在概念上与常规GAN设置相似,不同之处在于,此处训练样本是单幅图像不同尺度下的采样图像,而不是数据集中的整个图像样本。

结果

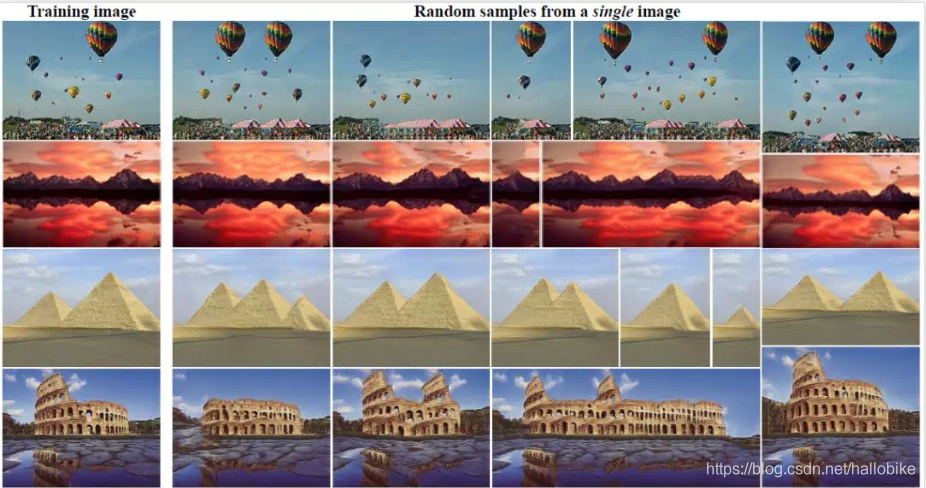

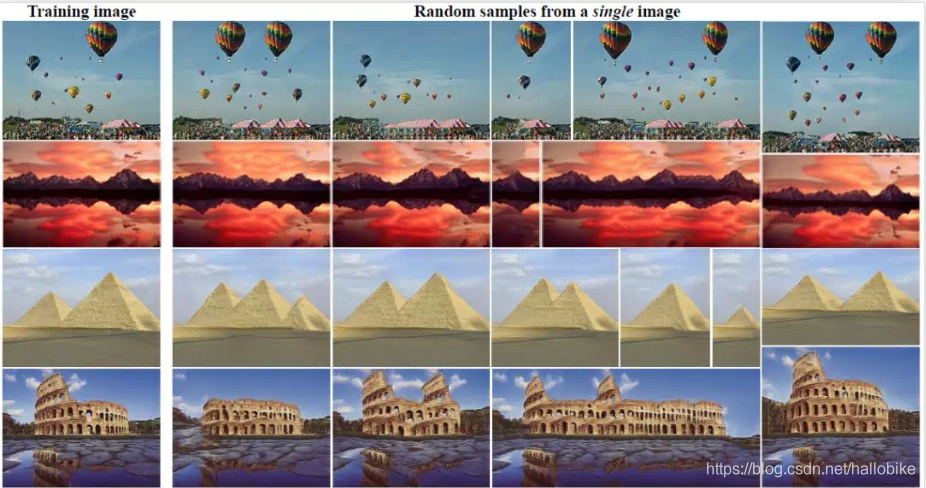

在训练时使用较少数目的尺度,则最粗尺度的有效感受野会更小,从而只能捕获精细纹理。随着尺度数量的增加,出现了更大的支撑结构,并且更好地保留全局目标的排列(位置关系)。测试时可以选择开始生成的尺度,SinGAN的多尺度结构可以控制样本间差异的总量。从最粗尺度开始生成会导致整体结构变化很大,在某些具有较大的显著目标的情况下,可能会生成不真实的样本。当从较细的尺度开始,可以保持整体结构完整,同时仅会改变更精细的图像特征。结果如下:

结论

本文介绍了一种可以从单幅自然图像中学习的新型非条件生成框架–SinGAN。证明了其不仅可以生成纹理,还具有为复杂自然图像生成各种逼真样本的能力。与外部训练的生成方法相比,内部学习在语义多样性方面具有固有的限制。例如,如果训练图像只包含一条狗,SinGAN不会生成不同犬种的样本。不过,作者通过实验证明,SinGAN可以为多种图像处理任务提供非常强大的工具。

cs